立即识别Twitter、LinkedIn、Substack等平台上的真人与AI账号。快来获取我们的全新Chrome扩展程序。

无论网民身处何处,他们都会被人工智能生成的文本、视频和图像所包围,其中许多内容难以辨别。网络空间的神圣性和可信度正在人工智能内容的重压下崩塌。拜登的《人工智能安全行政命令》和欧盟的《人工智能法案》曾倡导对人工智能产出进行适当标注(即“水印”),但这些规定在2025年被废除。 尽管缺乏国家或国际层面的战略,许多人工智能公司仍在其内容中开发并部署“水印”标识。虽然这是重获公众信任、保护消费者权益的正确方向,但水印技术本身存在缺陷,极易被绕过。

下面,我们将探讨水印的工作原理、为何会失效,以及为什么优秀的AI检测方法必须依赖某种特定的模式识别技术。

检测到AI水印,但看不见

对人类而言,AI水印是肉眼不可见的。与传统水印(通常显示公司名称或徽标)不同,AI水印以一种难以察觉的方式嵌入到AI模型生成的文本、图像和视频输出中。

谷歌使用了SynthID技术,该技术会在Gemini的输出结果中嵌入细微的差异,这些差异可通过谷歌自有的技术检测出来。对于文本,SynthID会根据伪随机函数调整某些单词的可预测性评分,从而使Gemini更倾向于使用特定单词。因此,当文本被重新输入到模型中时,模型可以通过词频分析识别出自己的生成内容。

根据美国法律,完全由人工智能生成的内容无法享有版权,因此,开发一种方法来确定其模型内容的来源,符合人工智能公司的利益。这样一来,一旦人工智能生成的文本、图像或视频在网络上传播,便会有一个标识来确认其来源。

科技巨头如此热衷于追溯来源,不仅仅是为了对模型生成的内容主张所有权。当互联网用户每天面对源源不断涌入眼帘的AI垃圾内容时,主要的人工智能开发商却担忧着可能面临的法律、声誉及安全风险。 不法分子利用AI工具制造深度伪造内容或散布虚假信息,威胁着全球安全。为了避免政府出台严格监管措施带来的潜在打击,科技巨头们正致力于开发自我监管工具,以抢占先机。如果他们的模型能够像生成内容一样轻松地解码内容,那么任何政府机构又何必去监管其发展呢?

坏消息:水印并非万无一失

如果全世界的人都承诺绝不篡改人工智能生成的内容,那么水印技术或许能奏效。但在现实世界中,恶意行为者可以轻易篡改人工智能生成的内容,使其来源难以辨别。诸如“人性化工具”之类的二次改写工具,可以轻松地更改词汇或句式结构,插入错误或无意义的词句,以此试图掩盖AI生成的内容。遗憾的是,这种拙劣的伪装有时竟能得逞。PangramLabs测试了19种不同的AI人性化工具,发现其中许多成功地从文本中去除了水印。

恶意行为者还可以通过将文本进行多次不同语言的翻译,再将其回译成英语,从而对文本进行“洗白”,以此去除水印,并生成一段不会触发人工智能公司解码系统的干净文本。

水印非常脆弱,容易被篡改,从而失去作用。检测水印需要借助其他工具。

统计模式识别

那些制造出由人工智能生成的垃圾内容的公司,不能仅靠自己来判断某条内容是否出自其手。水印技术需要人工智能开发者的配合,而且水印转眼间就能被去除。

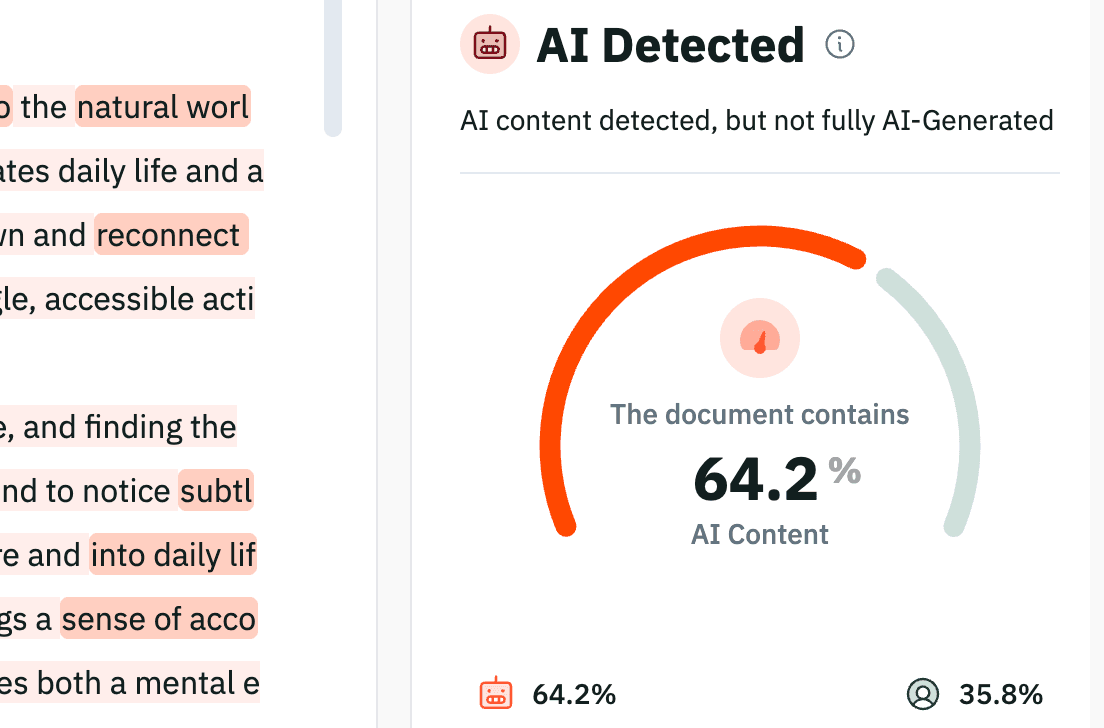

但一种方法失效时,另一种方法便能胜出。一种名为“独立统计模式识别”的方法在识别AI生成内容方面要稳健可靠得多,这也是Pangram在此采用该方法的原因。我们并不寻找嵌入在AI生成文本中的隐藏代码。相反,Pangram模型通过分析任意文本的基本语言“DNA”、结构可预测性以及语法模式,实现99.98%准确率的AI检测。 像Pangram这样的高级检测器无需依赖水印即可运行。它们通过一种名为“硬负样本挖掘”的方法,在多样化的数据集上进行训练——该方法会向检测器输入难以识别的样本。Pangram能够标记来自开源或未发布模型的AI生成内容,识别恶意篡改的文本,并对AI生成与人工撰写混合的文本提供逐行分析。

从自我监管到独立检测

人工智能公司不会成为互联网真实性的守护者。水印技术无法有效抵御恶意行为者,而独立检测才是唯一的真正解决方案。

我们的模型已在实际应用中得到运用。像Quora这样依赖用户信任的平台,已将其服务与API级别的检测功能集成,利用Pangram对数百万条帖子进行审核,并标记由AI生成的内容。

只有通过基于检测的框架,互联网才能真正实现真实性和透明度。像Pangram这样可靠、独立且技术领先的检测工具,正在为整个互联网建立制衡机制。

无论您是学者、专业人士还是IT开发人员:水印技术都不是万能的解决方案。要防范学术不端行为或AI生成的垃圾内容,必须依靠检测手段。为了准确核实论文、电子邮件和社交媒体帖子的来源,各机构必须使用能够分析文本的检测工具,而非依赖水印技术。

不要依赖水印来保护您的平台。使用 Pangram,可立即识别被篡改的 AI 生成内容。

以获取我们的最新动态